ChatGPT, le chatbot d’OpenAI est un sujet qui ne cesse de se démocratiser par ses multiples utilisations, mais aussi le fait qu’il devienne utilisable dans le quotidien de tout le monde à l’instar du téléphone portable.

Malgré tout, l’outil est loin d’être parfait puisqu’il lui arrive fréquemment de fournir des informations incorrectes que les développeurs du projet appellent “hallucinations”. Ces derniers entendent bien régler l’algorithme au plus vite afin de proposer une IA performante et fiable.

Des hallucinations problématiques

OpenAi a récemment annoncé sa volonté d’améliorer les capacités mathématiques à résoudre des problèmes de son chatbot GPT-4 dans le but de réduire ces fameuses hallucinations qui sont en frain évident au développement de l’IA.

Ainsi, en mars dernier, l’introduction de la version ChatGPT-4 a encore plus mis en avant cet outil remarque qui devient utilisé par tout le monde. Néanmoins, ChatGPT comme l’ensemble de ces nouveaux outils IA ont parfois du mal à fournir des informations fiables et produisent alors du contenu que l’on appelle hallucinations.

Il faut savoir que bien que le modèle de ChatGPT soit complexe, pour produire son contenu et répondre aux besoins des utilisateurs, c’est au final une histoire de probabilité en cherchant à rester cohérent sur une suite de mots en comparant des données existantes.

Or, ces hallucinations se manifestent lorsque le chatbot va générer de fausses informations que soit en créant des événements ou des gens qui n’existent pas ou encore fournir des informations inexactes sur un sujet en particulier.

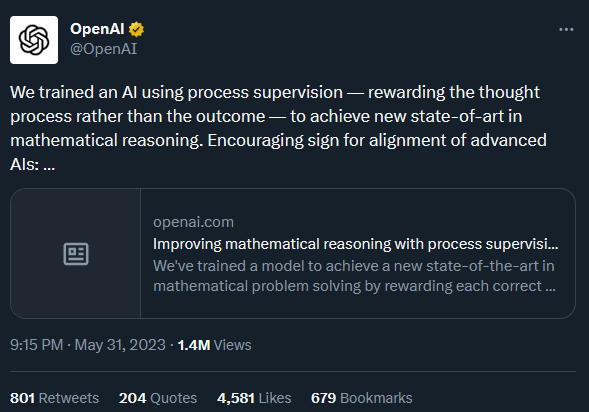

Ainsi, pour tenter d’améliorer les résultats de ChatGPT, OpenAI a mis en place deux nouveaux modèles fonctionnant sous la forme d’un “feedback” : avec d’un côté la supervision du résultat (outcome supervision) et de l’autre l’analyse du processus pour arriver à ce résultat (process supervision).

Un début de piste donnant lieu à davantage de recherches

Suite à une analyse poussée de ces deux modèles en les évaluant à l’aide de problèmes mathématiques à résoudre, les chercheurs d’OpenAi en ont conclu que le modèle “process supervision” fournit de meilleurs résultats et s’applique davantage à une logique humaine. À l’inverse, le modèle “outcome supervision” produit des résultats plus aléatoires dont il est difficile de déterminer une tendance.

Ainsi OpenAI a reconnu que ce nouveau modèle “process supervision” va au-delà des mathématiques et que plus de recherches sont nécessaires dans de nombreux domaines. Afin de faciliter la recherche, la société a publié le jeu de données complet en invitant quiconque à faire ses propres expériences et recherches sur le sujet.

Quand bien même OpenAI n’a pas fourni de cas donnant lieu à ces hallucinations, on se rappelle que Bard le chatbot de Google avait commis une erreur lourde de sens pour l’entreprise lors de sa démonstration.

Plus récemment encore, un avocat d’une grande compagnie a utilisé ChatGPT face à une affaire contre une compagnie d’aviation colombienne en citant de nombreux cas similaires. Seul problème, l’ensemble de ces cas étaient faux et une pire invention de ChatGPT.

On comprend donc mieux pour quoi il est nécessaire pour faire évoluer l’intelligence artificielle et même la développer de rendre ces chatbots plus performants et surtout retirer tout problème d’hallucination dans les données générées.

Source : Cointelegraph

Sur le même sujet :

- Le compte Twitter de la directrice technique d’OpenAI a été piraté

- Worldcoin : le nouveau projet du PDG d’OpenAI lève 115 millions de dollars

- La raison pour laquelle OpenAI et ChatGPT pourraient bientôt quitter l’Europe